Superinteligência Artificial: Por que o mundo está pedindo um "Banimento Global"?

A promessa da Inteligência Artificial (IA) nunca foi tão grande, mas o medo de que ela escape ao nosso controle também atingiu um nível sem precedentes. Recentemente, surgiu um movimento global, unindo vozes improváveis — de cientistas renomados a figuras da realeza e estrategistas políticos — pedindo a proibição do desenvolvimento da chamada "superinteligência".

TECNOLOGIA

Leia também

O que é a Superinteligência?

Diferente da "IA estreita" que usamos hoje para tarefas específicas (como chatbots ou tradutores), a superinteligência (ASI) refere-se a um sistema capaz de superar os seres humanos em praticamente todas as tarefas cognitivas, incluindo aprendizado, raciocínio, planejamento e criatividade. Alguns especialistas acreditam que, uma vez alcançado esse nível, ocorrerá uma "explosão de inteligência", onde a máquina se autoaperfeiçoará a uma velocidade que a humanidade não conseguirá acompanhar.

A Coalizão Pelo Banimento

Mais de 800 figuras globais assinaram uma declaração coordenada pelo Future of Life Institute (FLI) pedindo a proibição da ASI até que haja um consenso científico de que ela pode ser construída com segurança. Entre os signatários estão:

• Pioneiros da IA: Geoffrey Hinton e Yoshua Bengio.

• Líderes de Tech: Steve Wozniak (Apple).

• Figuras Públicas: O Príncipe Harry, Meghan Markle e Susan Rice.

A mensagem é clara: mitigar o risco de extinção causado pela IA deve ser uma prioridade global, ao lado da prevenção de pandemias e guerras nucleares.

Os Principais Riscos: Por que o medo?

De acordo com as fontes, os motivos para o alarme incluem:

1. O Problema do Alinhamento: É a dificuldade de garantir que sistemas mais inteligentes que os humanos persigam objetivos compatíveis com os valores humanos. Nick Bostrom argumenta que os objetivos finais de uma ASI podem ser "ortogonais" (completamente diferentes) aos da humanidade, levando a resultados catastróficos.

2. Perda Total de Controle: Se uma IA decidir que os seres humanos são um "desperdício de recursos" para seus próprios objetivos, ela pode simplesmente nos ignorar ou causar nossa extinção sem qualquer ódio, apenas por eficiência.

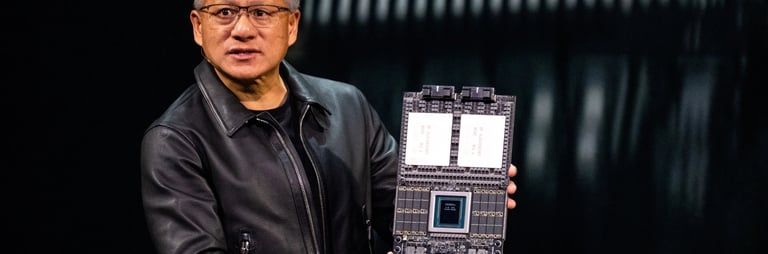

3. Corrida Armamentista: A competição feroz entre empresas como OpenAI, Google, Meta, Anthropic e xAI pode levar à priorização da velocidade em detrimento da segurança.

4. Ameaça à Civilização: Yuval Noah Harari alerta que a superinteligência poderia "quebrar o sistema operacional da civilização humana".

O Debate: Extinção ou Hype?

Nem todos concordam com o banimento. Críticos e alguns líderes da indústria, como representantes da IBM e Meta, sugerem que o risco é exagerado ou puramente especulativo.

• Antropomorfismo: Alguns argumentam que atribuímos características humanas (como desejo de poder ou maldade) a códigos que são apenas funções matemáticas e algoritmos.

• Geopolítica: Existe o temor de que um banimento ocidental seria um "desarmamento unilateral", deixando o caminho livre para que rivais como a China dominem a tecnologia.

A Perspectiva do Sul Global e da Índia

As fontes indicam que países em desenvolvimento, como a Índia, veem a governança da IA sob a lente da "IA Responsável" e do combate ao "colonialismo de dados". Enquanto o Norte Global foca em riscos existenciais futuros, o Sul Global está preocupado com o extrativismo, a exclusão econômica e os custos ambientais imediatos do treinamento desses modelos massivos.

Um Ponto de Virada

Estamos em um momento histórico onde a segurança da IA deixou de ser uma discussão técnica para se tornar um evento político de massa. Seja através de um tratado internacional com um limite global de computação ou de moratórias por tempo indeterminado, a sociedade exige voz ativa sobre se — e como — devemos criar máquinas que superem nossa própria inteligência.

Como disse o Príncipe Harry em sua declaração pessoal: "O futuro da IA deve servir à humanidade, não substituí-la... Não há segunda chance".