Revolução NVIDIA Vera Rubin: O Próximo Salto na Inteligência Artificial e o Impacto nos Data Centers

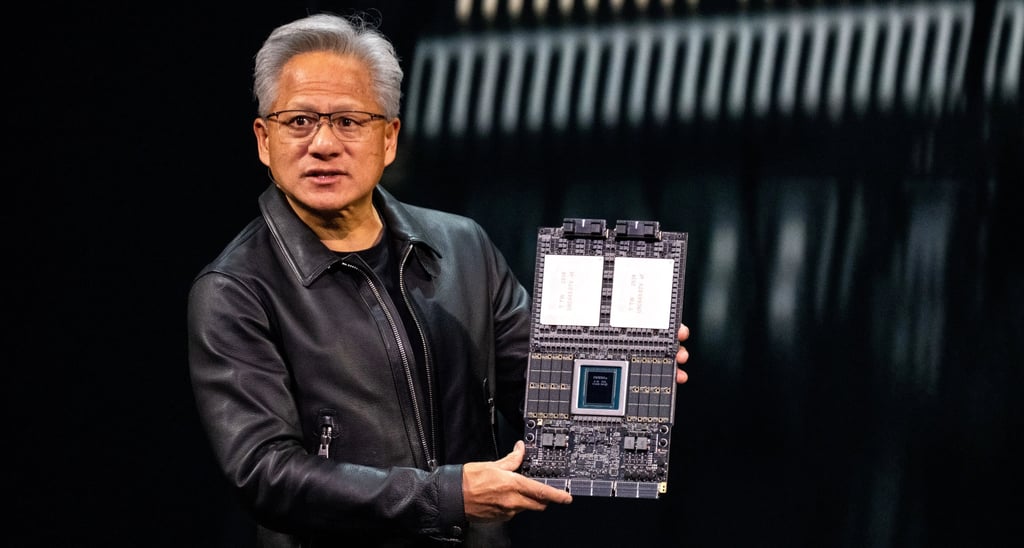

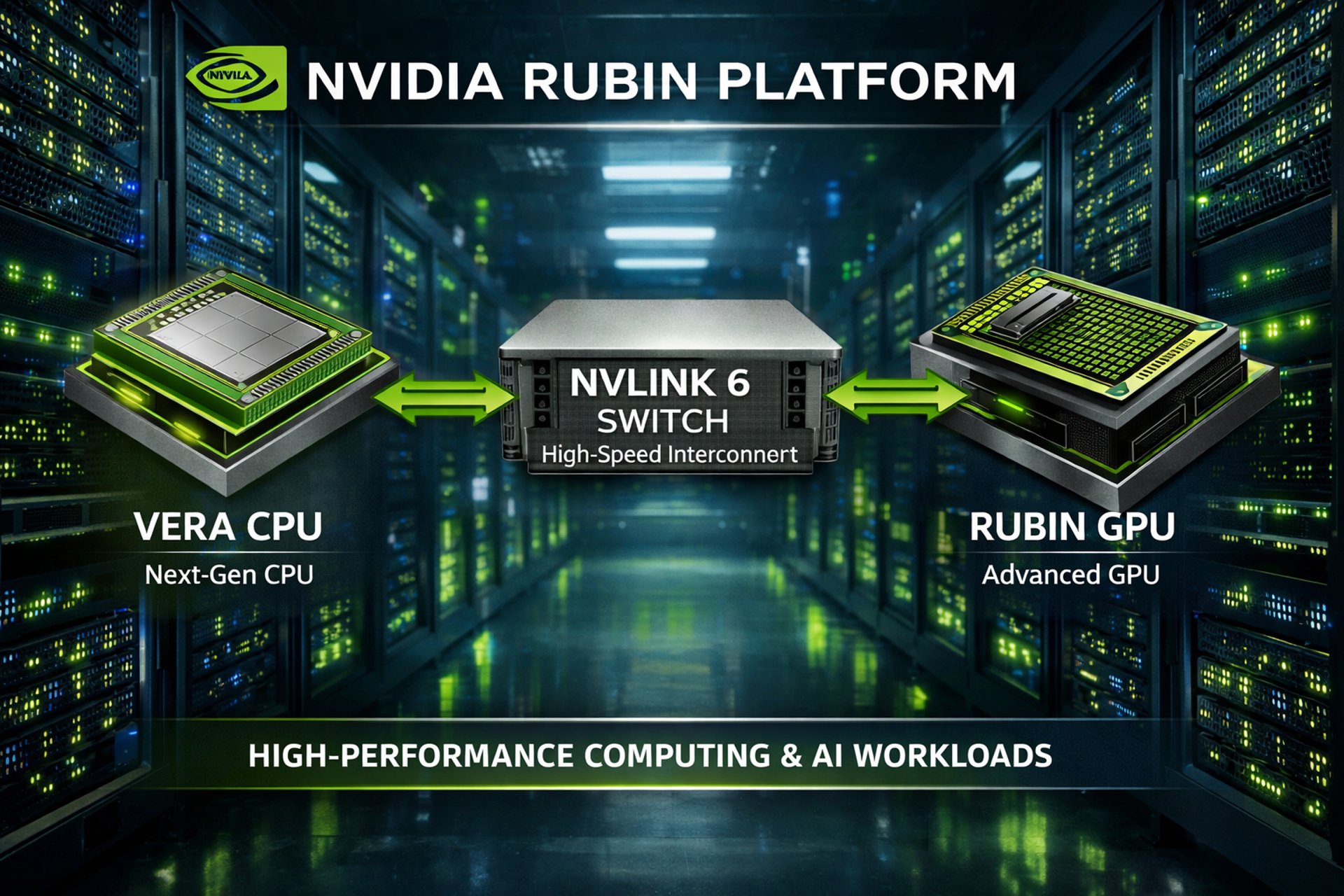

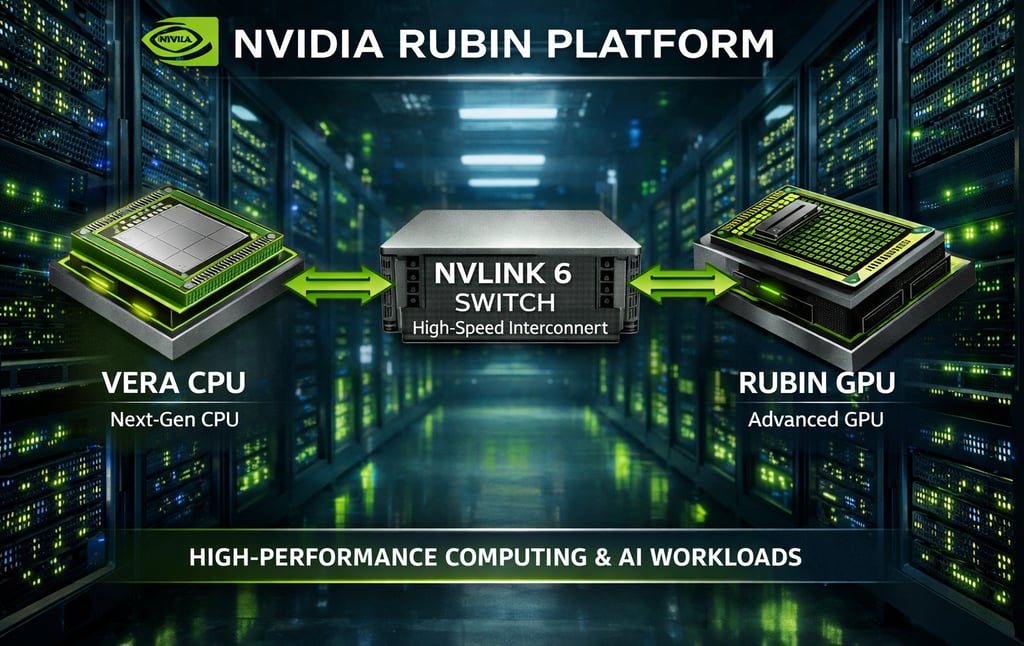

A NVIDIA anunciou recentemente sua plataforma de próxima geração, batizada de NVIDIA Rubin, marcando um avanço significativo na computação acelerada e na infraestrutura para IA. Nomeada em homenagem à astrônoma Vera Rubin, esta plataforma não é apenas um chip, mas um supercomputador de IA completo, projetado para atender à demanda explosiva por treinamento e inferência de modelos de larga escala.

TECNOLOGIA

1. A Arquitetura Vera Rubin: Seis Chips, Uma Supermáquina

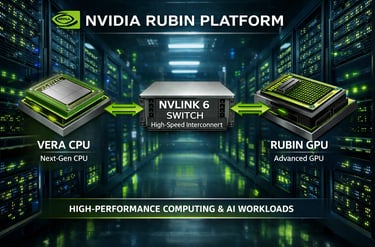

A plataforma Rubin baseia-se no conceito de "extreme codesign", integrando hardware e software em seis chips fundamentais que trabalham em harmonia:

• NVIDIA Vera CPU: Projetada para o que a empresa chama de "raciocínio agêntico", esta CPU é altamente eficiente em energia e conta com 88 núcleos customizados "Olympus" da NVIDIA.

• NVIDIA Rubin GPU: Equipado com a terceira geração do Transformer Engine, este chip oferece 50 petaflops de computação NVFP4 para inferência de IA.

• NVIDIA NVLink 6: Uma tecnologia de interconexão que fornece uma largura de banda de 3,6 TB/s por GPU. Um rack Vera Rubin NVL72 completo oferece incríveis 260 TB/s, uma capacidade superior à de toda a internet.

• BlueField-4 DPU e ConnectX-9 SuperNIC: Componentes vitais para gerenciar o tráfego de dados e a segurança dentro do data center.

• Spectrum-6 Ethernet Switch: A próxima geração de rede Ethernet otimizada para fábricas de IA de escala massiva.

Leia também

Softwares imprescindíveis para jogos

2. O Futuro do Hardware e a Evolução das IAs

A chegada da plataforma Rubin é uma resposta direta à evolução das IAs agênticas e modelos Mixture-of-Experts (MoE), que exigem processamento, raciocínio e ação em longas sequências de dados. Comparada à plataforma anterior (Blackwell), a Rubin promete:

• Redução de 10x no custo de geração de tokens de inferência.

• Redução de 4x na quantidade de GPUs necessárias para treinar modelos MoE.

• Eficiência energética 5x superior em sistemas de rede óptica Ethernet.

Líderes da indústria, como Sam Altman (OpenAI) e Mark Zuckerberg (Meta), destacam que a inteligência escala com a computação, e a Rubin fornece a infraestrutura necessária para que modelos mais avançados alcancem bilhões de pessoas com maior confiabilidade e memória.

3. Data Centers Avançados e o "Choque de Oferta" de SSDs

Para suportar o raciocínio avançado, a NVIDIA introduziu a Plataforma de Armazenamento de Memória de Contexto de Inferência (ICMS). Esta tecnologia atua como uma camada de armazenamento entre a RAM e o armazenamento tradicional, permitindo acesso a terabytes de contexto.

No entanto, essa necessidade de dados massivos traz um desafio para o mercado global de hardware:

• Cada rack NVL72 da Rubin pode consumir mais de 1.000 TB (1 PB) de SSDs dedicados.

• Estimativas indicam que, até 2027, a NVIDIA pode abocanhar sozinha cerca de 9,3% de toda a demanda global de memória NAND (usada em SSDs, celulares e cartões de memória).

• Isso pode gerar um "choque de oferta", tornando os SSDs para consumidores comuns mais caros e difíceis de encontrar, à medida que os fornecedores priorizam os orçamentos bilionários dos hyperscalers.

4. Perspectivas de Implementação

A plataforma Rubin já está em produção total, com disponibilidade prevista para a segunda metade de 2026. Grandes provedores de nuvem como Microsoft Azure, Google Cloud, AWS e Oracle Cloud Infrastructure já estão na fila para adotar esses sistemas. A Microsoft, por exemplo, planeja implementar racks NVL72 em suas futuras "superfábricas de IA Fairwater", visando uma escala sem precedentes para desenvolvedores e organizações.

Em resumo, a tecnologia Vera Rubin redefine o que é possível na computação de IA, mas seu impacto será sentido muito além dos data centers, moldando a economia global de hardware e a disponibilidade de componentes básicos de armazenamento nos próximos anos.